Una aplicación de realidad aumentada envía información relevante sobre su entorno a personas con discapacidad visual, a través de vibraciones y sonidos en el teléfono inteligente, con el fin de mejorar su percepción y su orientación y, con ello, facilitar su adaptación al lugar de trabajo así como su integración laboral.

Esta tecnología forma parte del proyecto de I+D+i denominado e-Glance, llevado a cabo por la Cátedra Indra-Fundación Adecco de Investigación en Tecnologías Accesibles en la Universidad Politécnica de Madrid (UPM) a través del Centro de Tecnología Biomédica de la UPM. El proyecto cuenta con la participación de los usuarios y principales beneficiarios, en particular, del Centro de Investigación y Desarrollo de Aplicaciones Tiflotécnicas (CIDAT) de la Organización Nacional de Ciegos de España (ONCE).

Funcionamiento de la aplicación

Aunque la App funciona a través de un smartphone, para facilitar su uso, está previsto emplear el bastón que las personas invidentes utilizan en su día a día para enviar y recibir instrucciones de su teléfono móvil, realizando movimientos ligeros con la mano. Adicionalmente, se intentará ampliar este uso más allá de e-Glance para disponer de un mayor número de funcionalidades controladas por el usuario de este modo.

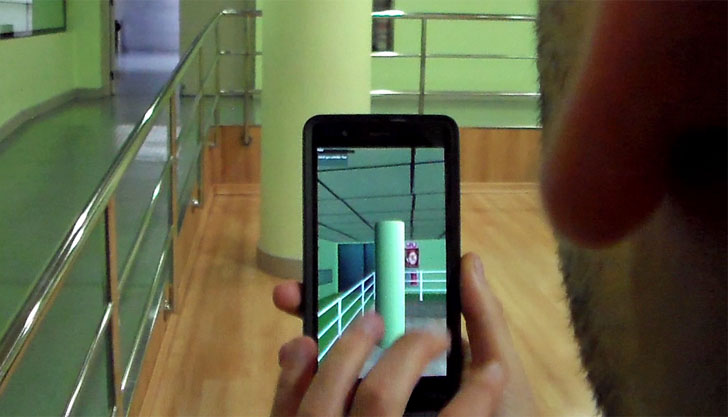

La implementación de la solución consta de tres pilares: un módulo de captación la realidad, basado en una red de sensores; un mundo virtual que refleja el mundo físico en tiempo real y con el detalle necesario para el correcto funcionamiento de la aplicación; y un tercer módulo de realidad aumentada, que, salvo contraorden, advierte al usuario de los cambios relevantes en su entorno y que también le permite obtener información detallada bajo demanda sobre zonas específicas de su interés.

La funcionalidad del primer prototipo de e-Glance ya ha sido probada por usuarios en una fase piloto, con varios objetos situados en una habitación diáfana, y en una segunda fase se probará en situaciones reales.

Para ello será necesario desplegar una red de sensores que permitan situar personas y objetos en tiempo real y reflejar virtualmente su ubicación sobre un escenario fijo, indicando su localización, volumen y forma, así como otros datos relacionados con su actividad y funcionamiento. Por último, se probará la tecnología de realidad aumentada desarrollada para ofrecer al usuario información sobre variaciones y movimientos significativos dentro de su campo de percepción en el momento en que se produzcan.